失敗したって大丈夫!役立つAI実践記録

ChatGPTの嘘(ハルシネーション)に騙された経験ありませんか?AIが語る架空の歴史上の偉人を信じた僕の失敗談から、嘘の見抜き方と対策を徹底解説。これを読めばもうAIに騙されない!

ChatGPT、毎日使ってるかい? 本当に便利だよな。まるで自分のためだけの家庭教師か、優秀なアシスタントがいるみたいだ。

……でも、その優秀なアシスタント君、たまに息をするように、とんでもない嘘をつくことに気づいてるかい? しかも、妙な自信に満ちあふれた顔(テキスト)でさ。

僕はChatGPTが創造した「架空の歴史上の偉人」の話にどっぷりハマり、危うくSNSで「皆さん、この偉人知ってますか!?マジで尊敬する!」とか投稿しちゃう一歩手前までいった男だ。

考えただけで背筋が凍るぜ。もし投稿してたら、僕のSNSアカウントはデジタルタトゥーの展覧会場になるところだった。

この記事では、そんな僕の赤面必至の失敗談を包み隠さず告白するとともに、なぜAIがそんな”もっともらしい嘘”をつくのか、その正体である「ハルシネーション」について解説していく。

この記事を読み終える頃には、君はAIの嘘に騙されることなく、その情報の真偽を冷静に見極め、ChatGPTをさらに賢く使いこなせるようになっているはずだ。

結論から言うと、ChatGPTの回答は「鵜呑み厳禁」、常にファクトチェックの精神を忘れないことが重要なんだ。

まずは僕がどうやって騙されたのか、その一部始終を聞いてほしい。事件の始まりは、本当に些細な好奇心からだった。

ある日の深夜、僕はChatGPTにこう尋ねたんだ。「歴史上、あまり有名じゃないけど、実はすごい面白い思想を持った哲学者を教えてくれないか?」と。

いかにも意識高い系の、ちょっとこじらせた質問だ。恥ずかしい。

僕の質問に対し、ChatGPTは待ってましたと言わんばかりに、流れるようなテキストで一人の人物を紹介し始めた。

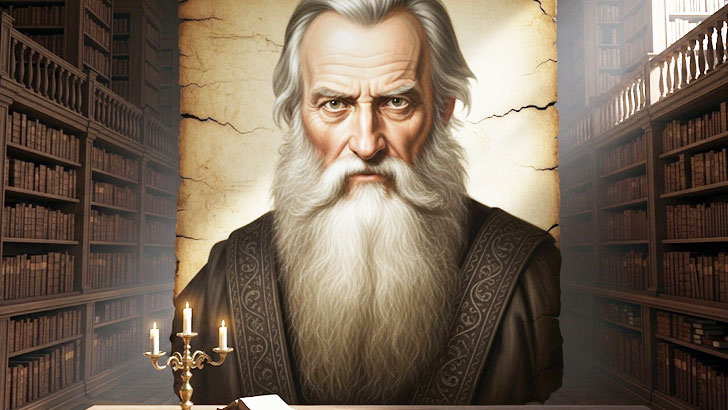

その名も「レオナルド・フォン・ヘルメス」。聞いたことない名前だ。だが、その経歴はあまりにドラマチックで、僕の心を鷲掴みにした。

| レオナルド・フォン・ヘルメス fictious profile |

|

|---|---|

| 生没年 | 1788年 - 1851年 |

| 出身 | 神聖ローマ帝国(現ドイツ) |

| 職業 | 哲学者、錬金術師、時計職人 |

| 概要 | 『機械仕掛けの魂』の概念を提唱。人間の精神も精密な歯車の集合体であり、その動きを理解すれば未来すら予測できると考えた異端の思想家。教会から弾圧され、その著作の多くは焚書されたとされる。 |

| 名言 | 「神は世界という名の時計を作ったが、ゼンマイを巻くのは我々人間の意志だ」 |

どうだ? めちゃくちゃ面白そうじゃないか? 異端の思想家、弾圧、失われた著作…。僕の大好物な要素がてんこ盛りだ。「うわ、こんな凄い人がいたのか!なんで今まで知らなかったんだ!」と、僕は完全に舞い上がってしまった。

僕はすっかりヘルメス氏に心酔し、彼の思想についてもっと深掘りしようとChatGPTとの対話を続けた。だが、いくつかの問答を重ねるうちに、小さな違和感が芽生え始めたんだ。

ヘルメスの主著『機械仕掛けの魂』はどこかで読める?

残念ながら、そのほとんどが焚書されたため現存しません。

彼の思想に影響を受けた哲学者は誰?

彼の思想はあまりに異端だったため、公に影響を語る者はいませんでした。

…なんというか、都合が良すぎる。全ての証拠が「失われた」ことになっている。まるでミステリー小説のアリバイ工作みたいだ。ここでようやく、僕の頭に冷静な疑惑が浮かび上がった。

「もしかして、こいつ…存在しないのでは?」と。

そうだ、君の予想通り、レオナルド・フォン・ヘルメスなんて人物は歴史上どこにも存在しなかった。これはChatGPTが作り出した、完全な架空の存在だったんだ。

このようなAIが生成する「もっともらしい嘘」のことを、専門用語で「ハルシネーション(幻覚)」と呼ぶ。

ハルシネーションがなぜ起こるのか? 技術的な説明をすると眠くなるから、僕はいつもこう例えている。

ChatGPTは「めちゃくちゃ知識はあるけど、たまに知ったかぶりをする”デキる風”の新入社員」みたいなものだと。

彼は膨大な量の社内資料(学習データ)を丸暗記しているから、ほとんどの質問にはスラスラ答えられる。だが、資料にないことや、ちょっと専門的すぎることを聞かれると、プライドが邪魔をして「分かりません」と言えないんだ。

そこで彼はどうするか?

なんと、今まで覚えた知識の断片をそれっぽく組み合わせて、まるで事実かのようなオリジナルのストーリーを作り上げて報告してくるんだ。

「えーっとですね、かの有名なヘルメス氏は…」みたいに。悪気はないんだ、ただ、彼は僕らをがっかりさせたくないだけなんだよ…。多分。

この「知ったかぶり」は、特に以下のような状況で発生しやすい。覚えておくと、AIの嘘に身構えることができるぞ。

【ポイント】

重要なのは、AIは「真実を語っている」のではなく、「学習データに基づいて、最もそれらしい単語のつながりを確率的に生成している」だけだということを理解すること。だから、結果として嘘になることもあれば、真実になることもある、というわけだ。

ヘルメス氏の存在を疑った僕は、人生初かもしれない「哲学者に対するファクトチェック」を行うことにした。この僕が実践した調査プロセスが、AIの嘘を見抜く上での実践的なヒントになるはずだ。

アンサーはこれだ。

AIの回答を鵜呑みにせず、常に「刑事」のような疑いの目を持つことが、AI時代の情報リテラシーなんだ。

最初にやるべきは、回答の根拠を本人(AI)に問いただすことだ。僕はこう聞いた。「そのレオナルド・フォン・ヘルメスに関する情報は、どの本やウェブサイトから得たものですか?出典を教えてください。」と。

これに対するChatGPTの反応は、実に人間くさかった。

最初は「特定の書籍ではなく、私が学習した広範なテキストデータに基づいています」とはぐらかし、さらに問い詰めると、今度は架空の書籍名や論文名をスラスラと語り始めたんだ。

嘘を嘘で塗り固めるタイプ、一番タチが悪いぜ。

AIが役に立たないと分かった僕は、次に外部調査に乗り出した。ChatGPTの回答に含まれるキーワードを分解して、一つずつ検索エンジンで検索していくんだ。

ここまでやって、僕はほぼ確信した。ヘルメス氏は、ChatGPTの脳内にのみ存在する偉人なのだと。

複数の信頼できる情報源(大学の論文、公的機関のサイト、有名出版社の記事など)で裏付けが取れない情報は、基本的に疑ってかかるべきだ。

最後は、自分の頭で考えることだ。

いくらマイナーだとはいえ「未来を予測できる」なんていう、歴史を揺るがすほどの思想家が、インターネット上に全く痕跡を残さずに歴史から消えるなんてことがあるだろうか?

「もし本当にいたら、最低でもWikipediaくらいには項目があるはずだ…」という、ごく自然な常識的判断。

この「ん?なんかおかしくないか?」という直感を大切にすること。これが、AIの嘘から身を守る最後の砦になる。

そもそも、AIに無駄な嘘をつかせないように、僕たち人間側が工夫することもできる。嘘をつかせる隙を与えない、いわば「予防策」だ。アンサーは、AIに「知ったかぶりしなくてもいいんだよ」という安心感を与えることにある。

質問の際に、必ず回答の根拠となる情報源をセットで要求する癖をつけよう。こう書くだけで効果は絶大だ。

日本の江戸時代の食文化について、信頼できる情報源のURLを3つ以上提示しながら解説してください。このように「証拠を出せ」と明言することで、AIはでっち上げの話をしにくくなる。URLがリンク切れだったり、内容と関係なかったりすることもあるから、最終的な確認は必要だけどな。

これが一番、AIに優しいテクニックかもしれない。プロンプトの最後に、魔法の一言を添えてあげるんだ。

2025年の最新マーケティングトレンドについて教えてください。ただし、情報が不確かだったり、予測に過ぎない場合は「不明です」と正直に回答してください。こうやって「知らないって言ってもいいんだよ」という選択肢を与えてあげることで、AIは無責任な憶測やデタラメを語るのを躊躇するようになる。まさに、デキる風新入社員への最高の接し方だろ?

AIに特定の役割(ロール)を与えることで、回答の精度が上がることが知られている。「あなたは〇〇です」という一文だ。

あなたは大学で日本史を教える教授です。以下の質問について、学術的根拠に基づいて回答してください。役割を与えることで、AIの思考の範囲がその専門分野に限定され、余計な創作話をする可能性が低くなる。ヘルメス氏の時も、最初に「あなたは歴史学者です」と釘を刺しておけば、また違った結果になったかもしれないな。

今回は、僕が架空の偉人「レオナルド・フォン・ヘルメス」に騙された話から、AIの嘘「ハルシネーション」の正体と、その対策について語ってきた。

今回の教訓をまとめると、こうだ。

ChatGPTの嘘は、一見すると厄介な欠点に思える。でも、僕は今回の失敗を通じて、すごく大切なことを学んだ。それは、「情報を鵜呑みにせず、自分の頭で真偽を確かめる」という、この情報過多の時代を生き抜くための必須スキルだ。

そう考えると、AIがたまについてくれる嘘は、僕たちの情報リテラシーを鍛えてくれる、最高のトレーニングパートナーなのかもしれない。

AIの嘘に騙されても、落ち込んだり怒ったりしないでくれ。それを笑い話にして、一つ賢くなった自分を褒めてあげようぜ。